TwinCAT Analytics ist ein Tool für die Datenanalyse von einer lokalen oder von vielen verteilten Maschinen. Die TwinCAT-Analytics-Produktfamilie bildet den gesamten Workflow einer solchen Analyse ab und beinhaltet verschiedenste Algorithmen für die Analyse von Livedaten sowie historischen Daten. Die Daten, die mithilfe von TwinCAT Analytics zu wertvollen Informationen und Entscheidungsgrundlagen verarbeitet werden, stellen den „Rohstoff“ für diesen Workflow dar.

Unsere Datenwertschöpfungskette – Prozessschritte in TwinCAT Analytics

In den folgenden Abschnitten nehmen wir Sie mit auf den Weg der Daten – von der Erfassung der Rohdaten bis hin zu möglichen Maßnahmen und Optimierungen – natürlich vollständig auf Basis von TwinCAT Analytics.

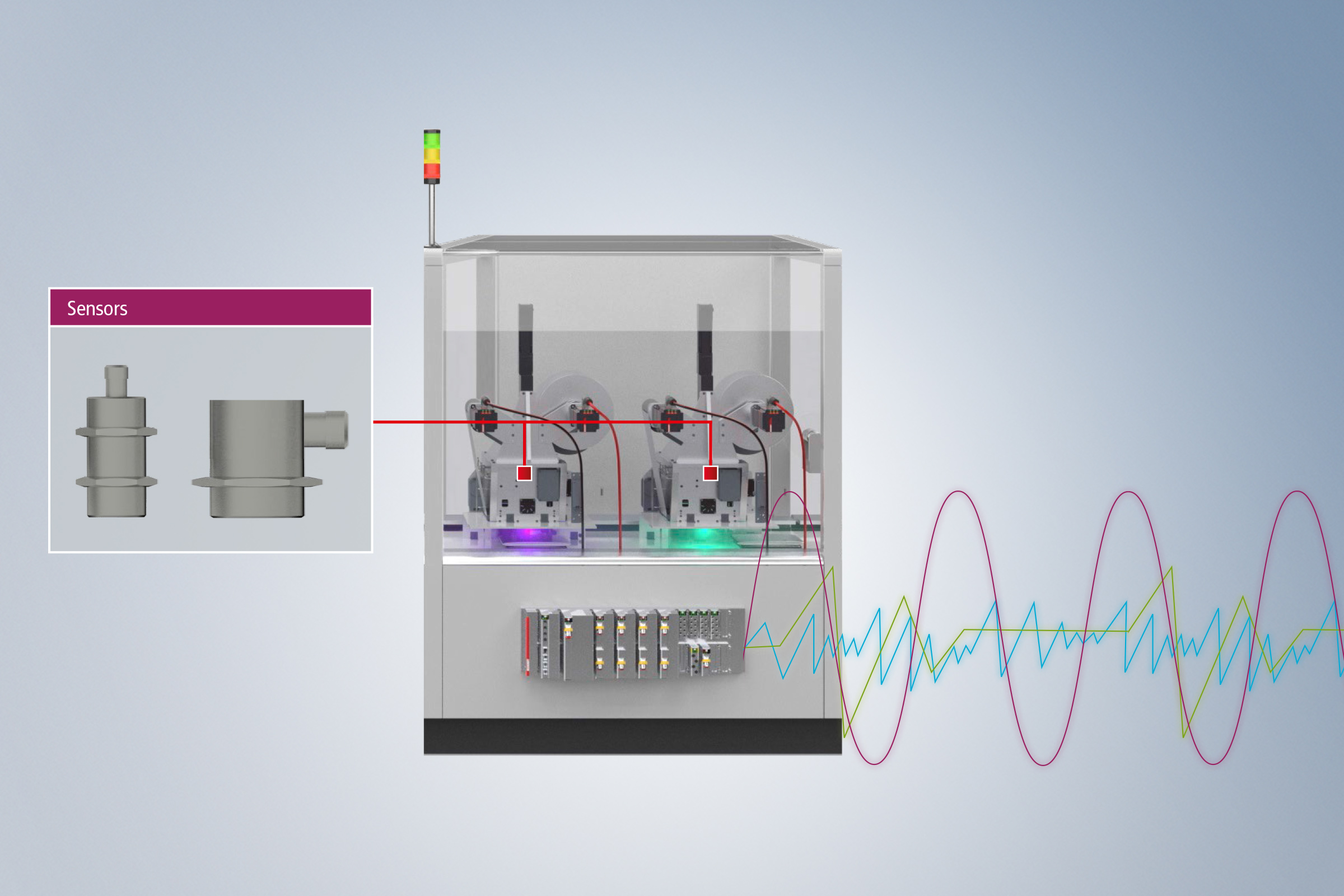

Schritt 1: Rohdatenerfassung

Wo kommen die Daten eigentlich her?

Die Qualität einer Analyse steht und fällt mit der Qualität der Daten („Garbage in – Garbage out“). Deshalb stellt die Rohdatenerfassung den Ausgangspunkt des Datenwertschöpfungsprozesses dar. Für eine erfolgreiche Analyse ist es relevant, zu erkennen, welche Daten für welchen Zweck benötigt werden und wie schnell Änderungen erfasst werden müssen (Abtastrate). TwinCAT Analytics bietet unterschiedliche Möglichkeiten für die kontinuierliche Erfassung des Prozessabbildes. Mithilfe hoher Abtastraten können große Datenmengen in Echtzeit erfasst werden - für eine hohe Datenqualität als Basis einer erfolgreichen Analyse und Modellbildung. Besonders zielführend ist die Verwendung des TwinCAT 3 Analytics Loggers, aber auch andere bekannte und bewährte Technologien und Produkte, wie zum Beispiel das TwinCAT 3 Scope View oder der TwinCAT 3 Database Server, können zum Einsatz kommen.

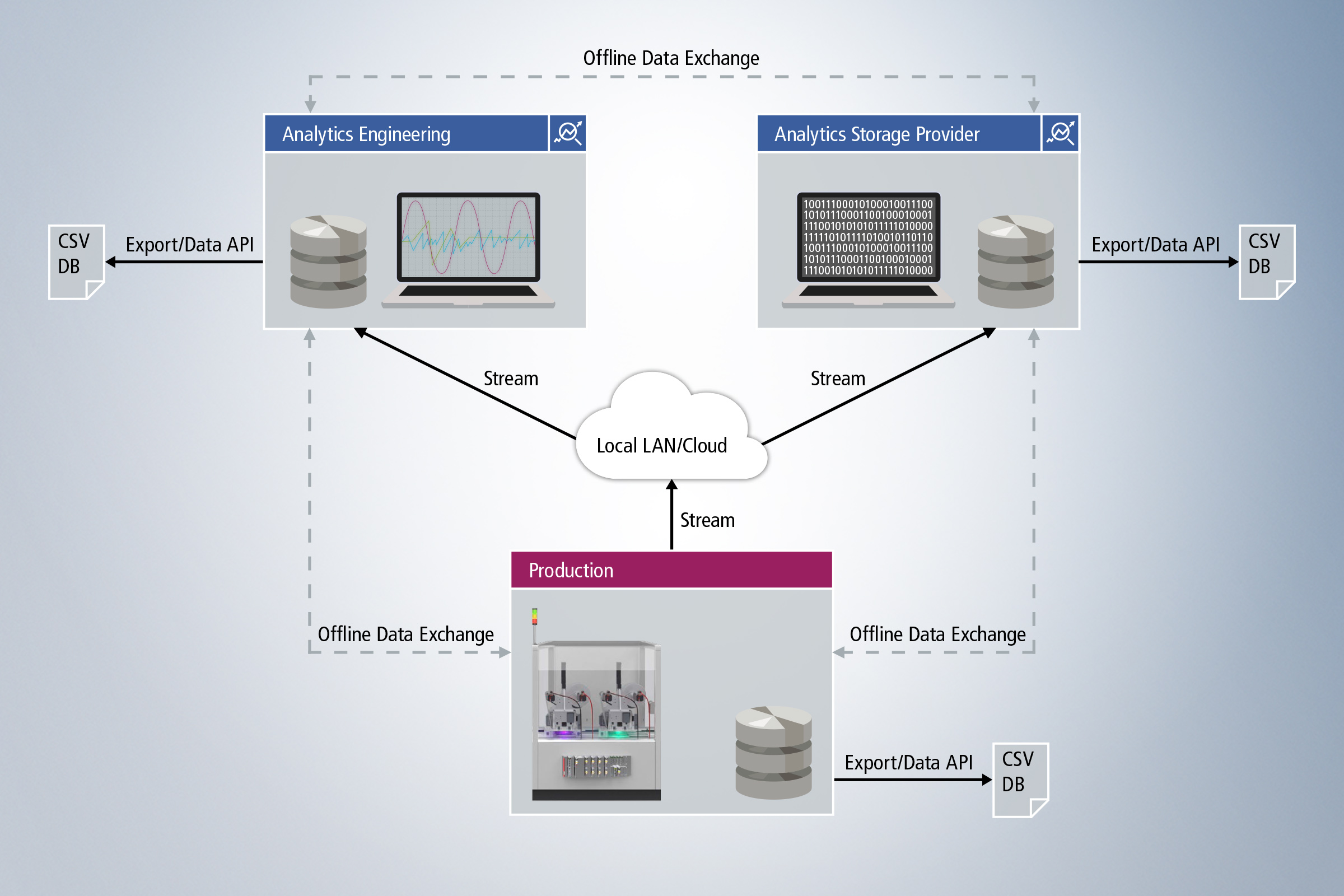

Schritt 2: Datenspeicherung und Kommunikation

Wie gelangen die Daten vom Ort der Aufzeichnung in meine Analyse?

Wo werden die Daten abgelegt und welche Zugriffsmöglichkeiten gibt es?

Im Anschluss an die Datenaufzeichnung oder direkt während der Aufzeichnung der Daten müssen diese übertragen oder gespeichert werden. Dabei bieten Ihnen unsere Produkte verschiedenste Möglichkeiten. Live-Daten können direkt per ADS oder MQTT für eine Live-Analyse übertragen werden. Wurden die Daten zunächst auf dem lokalen Zielsystem oder im Netzwerk mit dem TwinCAT 3 Analytics Storage Provider historisiert, können Analytics Files zu einem späteren Zeitpunkt auf ein anderes System übertragen und archiviert werden. Auch der Import in Datenbanken oder der Export in andere Dateiformate sind möglich.

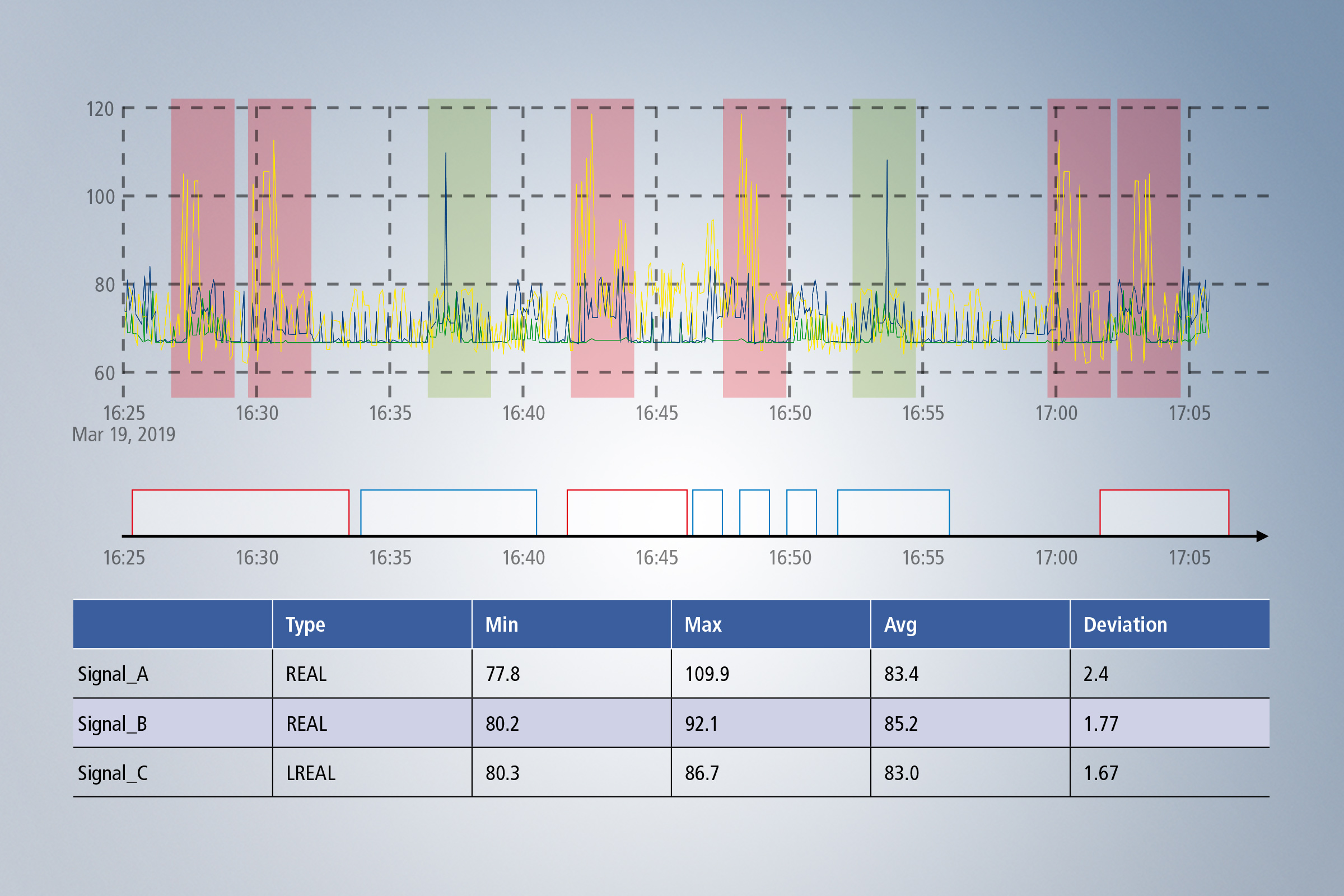

Schritt 3: Datenaufbereitung und explorative (Vor-)Analyse

Wie werden die Daten aufbereitet und für die Analysen nutzbar gemacht?

Wie wird eine problemspezifische Analyse designt?

In vielen Fällen führt der Weg zu einer erfolgreichen Analyse zunächst über eine Datenvorverarbeitung und eine explorative Voranalyse der Daten. Denn nicht immer ist von vornherein klar, welche Datenströme mithilfe welcher Algorithmen verarbeitet werden müssen, um zu einer sinnvollen Analysekette zu gelangen, die die gewünschten Ergebnisse und Handlungsempfehlungen liefert. Daher müssen zunächst relevante Datenströme und gegebenenfalls auch Zeiträume und Ereignisse identifiziert werden. Dabei kann Ihnen der Data Scout, der in die TwinCAT 3 Analytics Workbench und in das TwinCAT 3 Analytics Service Tool integriert ist, behilflich sein. Dieser bietet eine schnelle Übersicht einzelner Datenaufnahmen und ermöglicht zudem das Ausschneiden und Verknüpfen von Daten verschiedener Datenaufnahmen zu einem neuen Datenstrom. Sind die entsprechenden Daten ausgewählt, müssen zudem passende Algorithmen und Verknüpfungen gefunden werden. Dazu bietet Ihnen die TwinCAT 3 Analytics Workbench mit dem integrierten Konfigurator die besten Möglichkeiten. Sie können die verschiedenen Algorithmen ganz einfach per Drag-and-Drop aus der Toolbox in den Konfigurator ziehen und mit Ihren Daten und weiteren Algorithmen verknüpfen und entsprechend Ihren Vorstellungen parametrisieren. Falls Sie anwenderspezifische Algorithmen benötigen, besteht zudem die Möglichkeit, die vorhandene Algorithmik durch die neuen Analytics-Lambda-Funktionen zu erweitern, die wizardgestützt realisiert werden können.

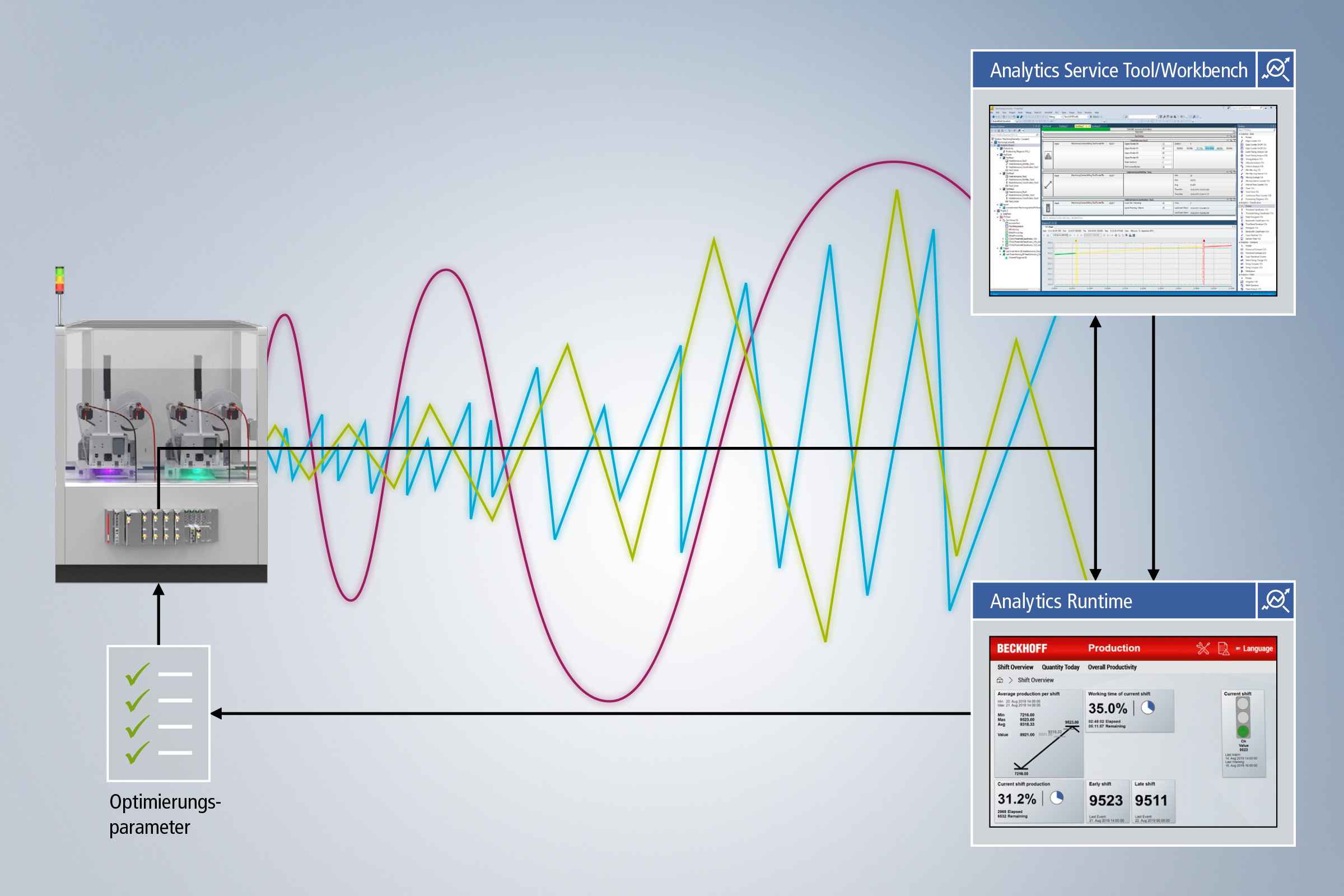

Schritt 4: 24/7-Datenaufzeichnung, Analyse und Einbindung in den Betrieb

Auf welche Weise kann die erstellte Analyse dauerhaft und kontinuierlich genutzt werden?

Im Anschluss an die Identifizierung der relevanten Daten können Sie diese für eine kontinuierliche Datenaufnahme auswählen. Dafür kann wieder der TwinCAT Analytics Logger konfiguriert werden, der die selektierten Datenströme während der Laufzeit der Steuerung mitschreibt und somit eine durchgängige Datenerfassung ermöglicht. Durch die automatische Codegenerierung können Sie aus der zuvor in der Workbench erstellten problemspezifischen Analysekette SPS-Code generieren. Dieser kann dann ebenfalls dauerhaft in den Betrieb eingebunden werden und 24/7 die gewünschte Analyse der aufgezeichneten Daten durchführen. Damit können mögliche Fehlerfälle zeitnah und vorausschauend erkannt und Zusammenhänge sowie Optimierungspotenziale auch über lange Zeiträume aufgedeckt werden.

Schritt 5: Visualisierung der Analyseergebnisse

Wie können die Analyseergebnisse übersichtlich dargestellt werden?

Den nächsten konsequenten Schritt in Bezug auf eine dauerhafte Einbindung der Analyse in den Betrieb stellt die kontinuierliche Visualisierung des Maschinenzustands sowie der Analyseergebnisse dar. Durch das One-Click Dashboard ist dieser Schritt ganz nah und für Sie als Anwender besonders einfach umsetzbar. Bereits beim Design der Analyse in der Workbench können Sie Konfigurationseinstellungen für das spätere Dashboard treffen. Das Dashboard wird dann automatisch generiert und kann flexibel angepasst werden. Dies ermöglicht Ihnen eine interpretierbare Visualisierung Ihrer Daten und Analyseergebnisse integriert in die TwinCAT HMI, die gleichzeitig eine intuitiv bedienbare Benutzerschnittstelle darstellt.

Schritt 6: Maßnahmen und Optimierungen

Wie können Maßnahmen abgeleitet und Optimierungspotenziale genutzt werden?

Aus den kontinuierlichen Analysen können fortlaufend Maßnahmen abgeleitet werden, die Maschinenstillstandszeiten verkürzen und die Lebensdauer der Maschinen und Anlagen verlängern sowie die Produktqualität steigern. Außerdem können aus den „On Demand“-Analysen in der TwinCAT 3 Analytics Workbench oder dem TwinCAT 3 Analytics Service Tool Optimierungspotenziale, z. B. zur Optimierung der Prozesse oder aber auch Maschinen, abgeleitet und in die Produktion integriert werden. Wenn Maßnahmen und Konsequenzen auf Variablenebene abgeleitet werden, können sie auch direkt zurück in die Steuerung geschrieben werden, sodass sich der Analyse-Handlungs-Kreislauf schließt.

Unsere TwinCAT Analytics-Produkte im Datenworkflow

Erfahren Sie im folgenden Video, wie die Produkte von TwinCAT Analytics die einzelnen Prozessschritte der Datenwertschöpfung vollständig abdecken. Alle oben genannten Schritte, von der Rohdatenerfassung über die Datenspeicherung, Datenaufbereitung, 24/7-Datenaufzeichnung, Visualisierung bis hin zur Optimierung auf Variablenebene werden durch die Softwarekomponenten von TwinCAT Analytics realisiert. Und das ohne großen Engineeringaufwand und komplexe SPS-Code-Programmierung. Die meisten Anwendungsszenarien lassen sich durch bereits implementierte Algorithmen und unterstützende Wizards abbilden.

Profitieren Sie von der Einfachheit der technologischen Umsetzung der Datenanalyse mit TwinCAT Analytics und nutzen Sie Ihre Daten gewinnbringend mit der so möglichen Entwicklung neuer Geschäftsmodelle für Ihr Unternehmen.

Produkte

TE1300 | TwinCAT 3 Scope View Professional

Das TwinCAT 3 Scope View ist ein Software-Oszilloskop für die grafische Darstellung von Signalverläufen in verschiedenen Chart-Typen. Dies können beispielsweise YT-, XY-, Bar- oder Digital-Charts sein. Das Scope View Professional erweitert die mit TwinCAT 3 XAE ausgelieferte Scope-View-Base-Version um weitere Funktionalitäten. Das Anwendungsgebiet bezieht sich auf Prozesse, die über einen längeren Zeitraum verfolgt und überwacht werden sollen.

TE3500 | TwinCAT 3 Analytics Workbench

Die TwinCAT 3 Analytics Workbench ist ein TwinCAT 3 Engineering-Produkt zur Erstellung von kontinuierlichen Datenanalysen. Die Daten können dabei aus verschiedenen Applikationen wie Maschinen, Gebäuden oder beispielsweise Energiesystemen kommen. Die Konfiguration der Workbench ist im Microsoft Visual Studio integriert und als grafische Benutzeroberfläche angelegt. In einer Toolbox stehen viele Algorithmen zur Konfiguration der Analyse zur Verfügung:

TE3510 | TwinCAT 3 Analytics Vision

TwinCAT 3 Analytics Vision bietet die Möglichkeit, Vision-Algorithmen in einer einfachen grafischen Darstellung für eine Applikation zu konfigurieren und zu testen. Programmierkenntnisse sind nicht erforderlich. Auf Knopfdruck können aus der erstellten Konfiguration automatisch SPS-Code auf Basis der TF7xxx-Vision-Produkte und ein HTML-basiertes Dashboard erzeugt werden. Der erzeugte Code kann in die Maschinensteuerung integriert und lokal ausgeführt werden. Alternativ kann der Code auf ein Remotegerät geladen und die Bildverarbeitung dort vorgenommen werden.

TE3511 | TwinCAT 3 Analytics Energy

TwinCAT 3 Analytics Energy bietet die Möglichkeit, Algorithmen für die Auswertung von elektrischen Energiesystemen in einer einfachen grafischen Darstellung für eine Applikation zu konfigurieren und zu testen. Programmierkenntnisse sind nicht erforderlich. Auf Knopfdruck können aus der erstellten Konfiguration automatisch SPS-Code auf Basis der Produkte TF3650 und TF83xx und ein HTML-basiertes Dashboard erzeugt werden. Mit dem erzeugten Code können RMS-Werte von Strom und Spannung, von Frequenzen, Harmonische und andere Kennwerte zur Beurteilung der Netzqualität kontinuierlich überwacht werden. Besonders vorteilhaft ist es, die Analyse auch direkt mit einer I/O-Konfiguration zu verknüpfen, sodass der Anwender nur noch bei Bedarf ein TwinCAT-Projekt nutzen kann.

TE3512 | TwinCAT 3 Analytics Condition Monitoring

TwinCAT 3 Analytics Condition Monitoring bietet die Möglichkeit, Algorithmen für die Auswertung von mechanischen und elektrischen Komponenten in einer einfachen grafischen Darstellung für eine Applikation zu konfigurieren und zu testen. Programmierkenntnisse sind nicht erforderlich. Auf Knopfdruck können aus der erstellten Konfiguration automatisch SPS-Code auf Basis der TF3600-Condition-Monitoring-Bibliothek und ein HTML-basiertes Dashboard erzeugt werden. Mit dem erzeugten Code kann die Komponenten einer Maschine kontinuierlich überwacht werden. Besonders vorteilhaft ist es, die Analyse auch direkt mit einer I/O-Konfiguration zu verknüpfen, sodass der Anwender nur noch bei Bedarf ein TwinCAT-Projekt nutzen kann.

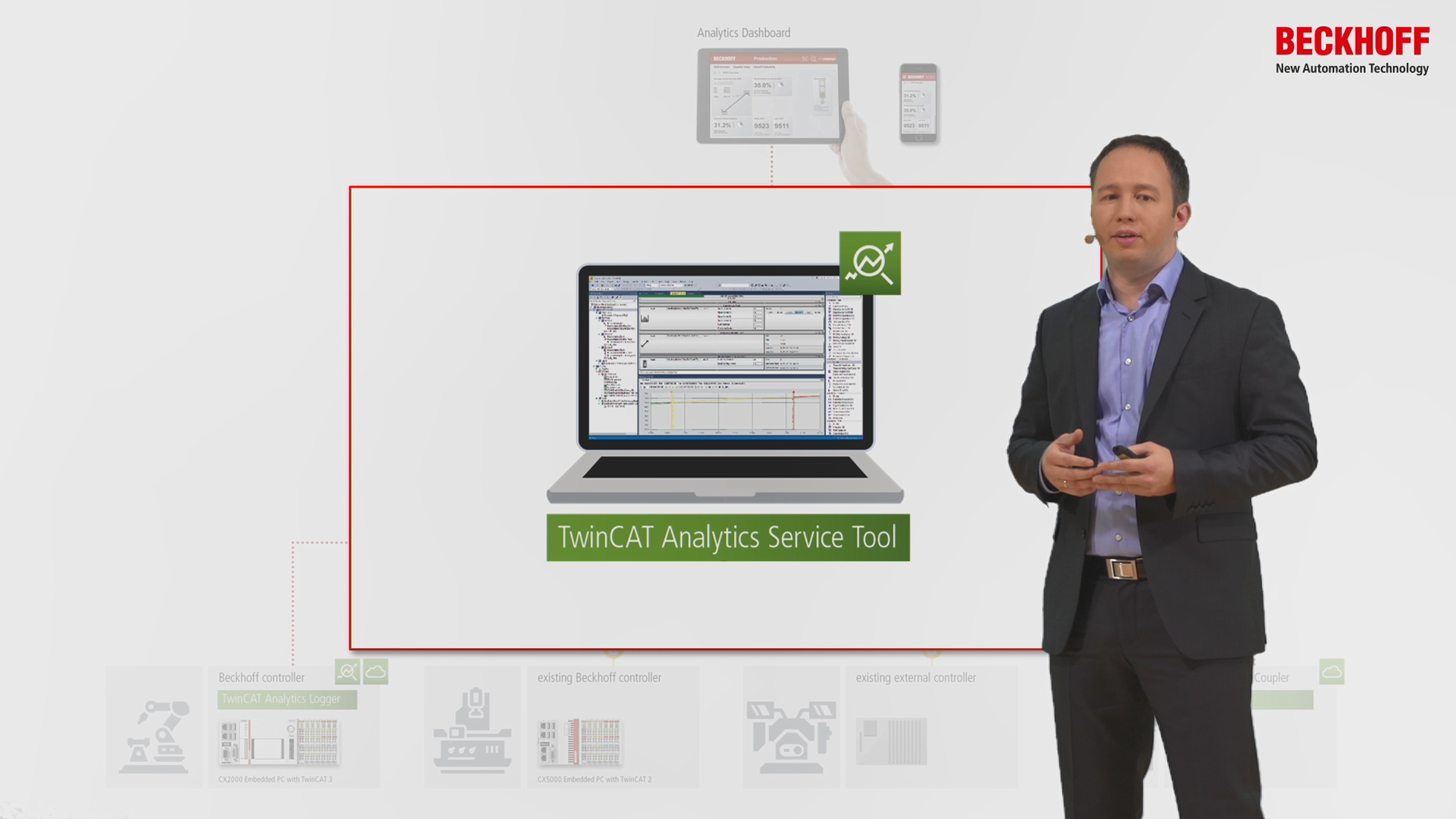

TE3520 | TwinCAT 3 Analytics Service Tool

Das TwinCAT 3 Analytics Service Tool ist ein TwinCAT-3-Engineering-Produkt zur Auswertung von Live- und / oder historisierten Daten. Die Daten können dabei aus verschiedenen Applikationen wie Maschinen, Gebäuden oder beispielsweise Energiesystemen kommen. Die Konfiguration des Service Tools ist im Microsoft Visual Studio integriert und als grafische Benutzeroberfläche angelegt. In einer Toolbox stehen viele Algorithmen zur Konfiguration der Analyse zur Verfügung:

TF3500 | TwinCAT 3 Analytics Logger

Der TwinCAT 3 Analytics Logger sorgt für die zyklussynchrone Erfassung von Prozess- und Applikationsdaten der Maschinensteuerung. Der Logger zeichnet sich durch eine hohe Performance aus, da er direkt im Echtzeitkontext der TwinCAT-Steuerung arbeitet. Die erfassten Daten werden wahlweise per IoT-Kommunikationsprotokoll MQTT an einen Message Broker übertragen oder lokal, auf der Festplatte der Maschinensteuerung in einer Datei, abgelegt und mit Ringpuffer-Funktionalität bespielt. Die dafür notwendige Konfiguration erfolgt in Microsoft Visual Studio® innerhalb des TwinCAT-Projekts. Alle Variablen des Prozessabbildes und der SPS-Applikation können sehr einfach per Checkbox ohne Programmieraufwand zur Konfiguration hinzugefügt werden.

TF3510 | TwinCAT 3 Analytics Library

Die TwinCAT 3 Analytics Library ist eine SPS-Bibliothek mit Analysefunktionen für Prozess- und Applikationsdaten. Sie kann lokal auf der Maschinensteuerung oder auf einem Remote-Analysesystem mit IoT-Kommunikationsanbindung eingesetzt werden. In beiden Anwendungsfällen kann mit der automatischen SPS-Code-Erzeugung der TwinCAT 3 Analytics Workbench TE3500 viel Engineering-Zeit eingespart werden. Für den lokalen Einsatz erfolgt nur das Mapping manuell, im IoT-Workflow entfällt sogar das Mapping und wird automatisch durchgeführt.

TF3520 | TwinCAT 3 Analytics Storage Provider

Der TwinCAT 3 Analytics Storage Provider ist ein MQTT Client und bildet die Schnittstelle zwischen einem oder mehreren MQTT Message Brokern und den entsprechenden Daten-Storages. Verschiedene Steuerungen können Daten per MQTT schicken, die der Storage Provider so zentralisiert abspeichern kann. Dabei kann es sich um zyklische Rohdaten handeln, aber auch um vorverarbeitete Daten. Das Einlesen der historisierten Daten funktioniert ebenfalls über den Storage Provider. Er kann so die Daten im Engineering für den Servicetechniker oder in einem Analytics Dashboard im Interactive Chart für den Produktionsleiter ausgeben.

TF3550 | TwinCAT 3 Analytics Runtime

Die TwinCAT 3 Analytics Runtime ist der Container, in dem die Analytics-Applikation abläuft, welche in der TwinCAT 3 Analytics Workbench TE3500 konfiguriert und entwickelt wurde. Die Runtime kann dabei lokal, auf einer Remote-Hardware oder in einer virtuellen Maschine installiert sein. Sie beinhaltet auch den TwinCAT 3 HMI Server TF2000, der das erstellte Analytics-Dashboard hostet. Zusammenfassend ist die TwinCAT 3 Analytics Runtime ein Bundle von verschiedenen Lizenzen. Enthalten ist eine SPS-Laufzeit, die Analytics-SPS-Bibliothek, die IoT-Anbindung mit MQTT und HTTPS/Rest, die Storage-Provider-Anbindung, der TwinCAT 3 HMI Server und ein entsprechendes Client-Paket, damit mehrere Nutzer gleichzeitig auf das designte Analytics-Dashboard schauen können.

TF35xx | Neue Features

Die TwinCAT 3 Analytics Functions haben zusätzliche Erweiterungen ihrer Funktionen erhalten.